Bài viết & Thông báo

Cập nhật bài viết và thông báo mới nhất từ khoa An toàn Thông tin

8 kết quả#Agentic AI

blogs

blogsGiới thiệu toàn diện về Trí tuệ nhân tạo trong bối cảnh chuyển đổi số

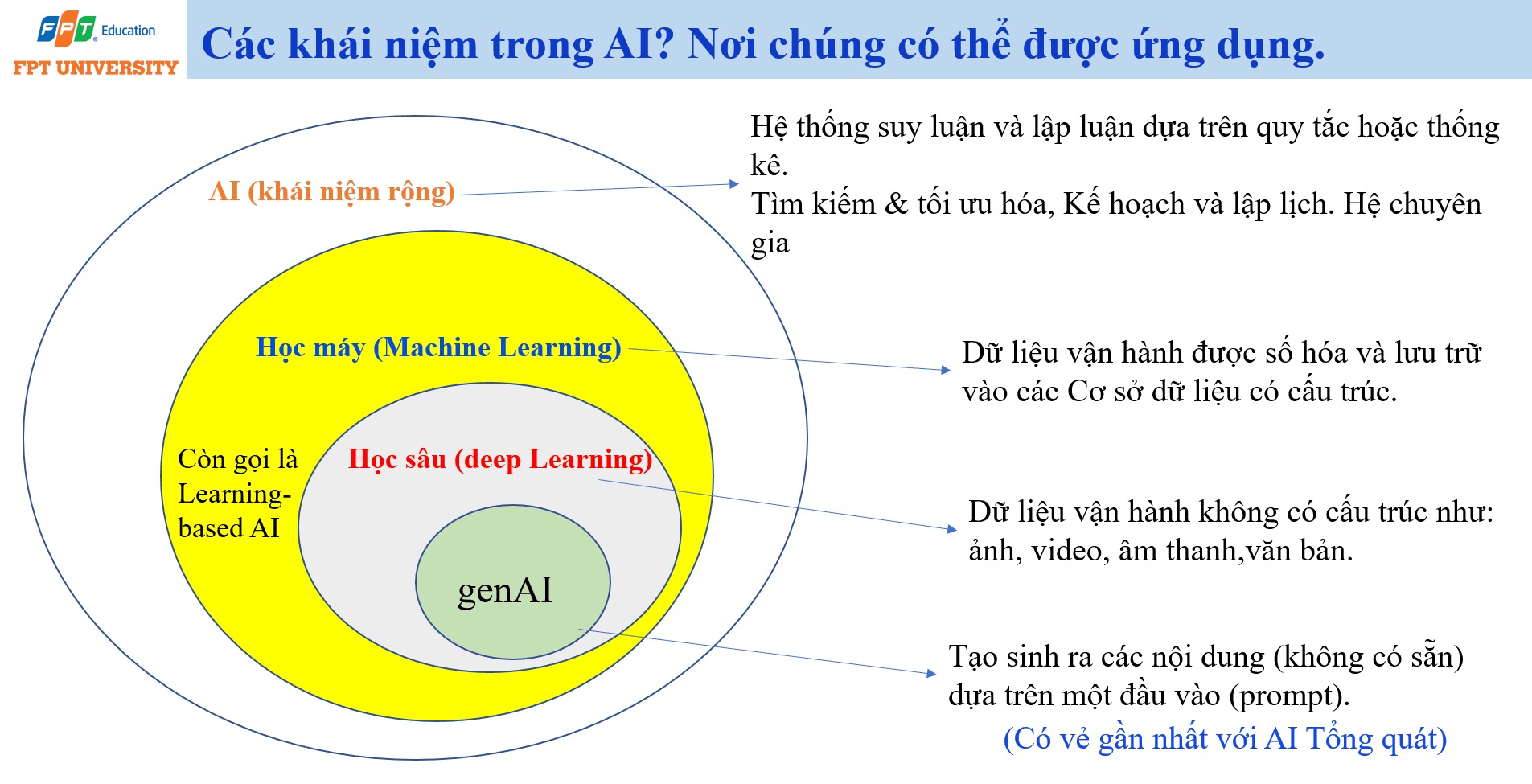

Bài luận giới thiệu tổng quan về trí tuệ nhân tạo (Artificial Intelligence), bắt đầu từ bối cảnh cách mạng công nghiệp lần thứ tư và vai trò của chuyển đổi số (Digital Transformation) như một vòng lặp cải tiến liên tục. Nội dung phân tích AI từ các khái niệm nền tảng như Machine Learning, Deep Learning, GenAI, LLM, AI Agent đến Agentic AI, đồng thời làm rõ tác động của AI đối với lao động, sản phẩm, dịch vụ, dữ liệu lớn, quản trị tổ chức và năng lực cạnh tranh của doanh nghiệp. Bài viết cũng trình bày các khía cạnh cần quan tâm khi triển khai AI, bao gồm AI Literacy, đạo đức AI, quyền riêng tư, bảo mật, lựa chọn giữa AIaaS và tự phát triển, cùng các tiêu chí đánh giá hệ thống AI như chi phí, độ trễ, độ chính xác, độ ổn định và an toàn.

blogs

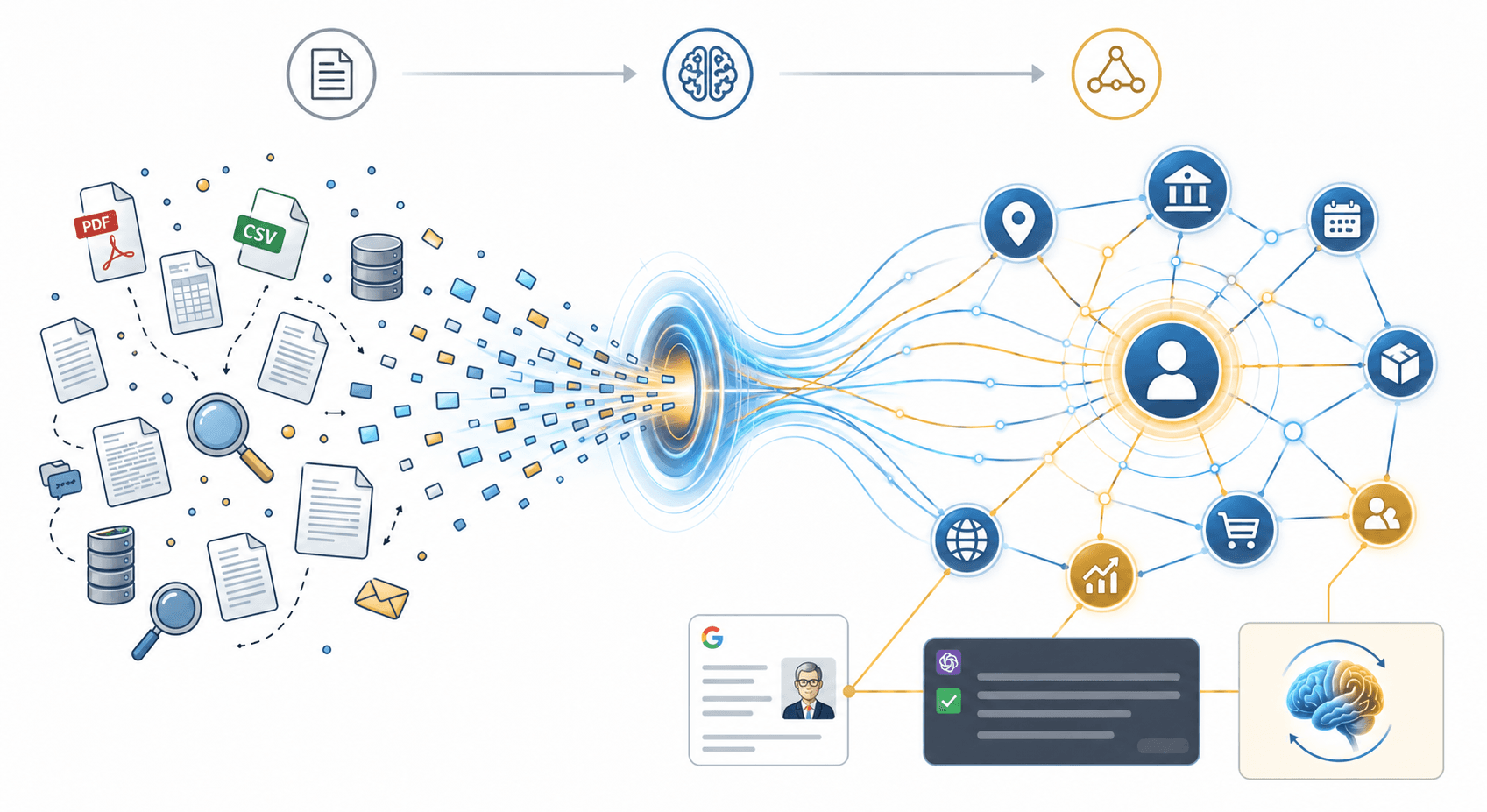

blogsĐồ thị tri thức - Bài 0: Khi dữ liệu không còn đứng một mình

Mỗi ngày bạn dùng Google, Netflix, bản đồ, mua hàng online – và mỗi lần đó, có một thứ đang âm thầm nối các mảnh thông tin rời rạc lại thành câu trả lời đúng. Thứ đó là gì, hoạt động như thế nào, và tại sao nó lại quan trọng hơn bao giờ hết trong thời đại AI? Đây là bài đầu tiên của chuỗi bài về Đồ thị tri thức – bắt đầu không phải từ lý thuyết, mà từ đời sống.

blogs

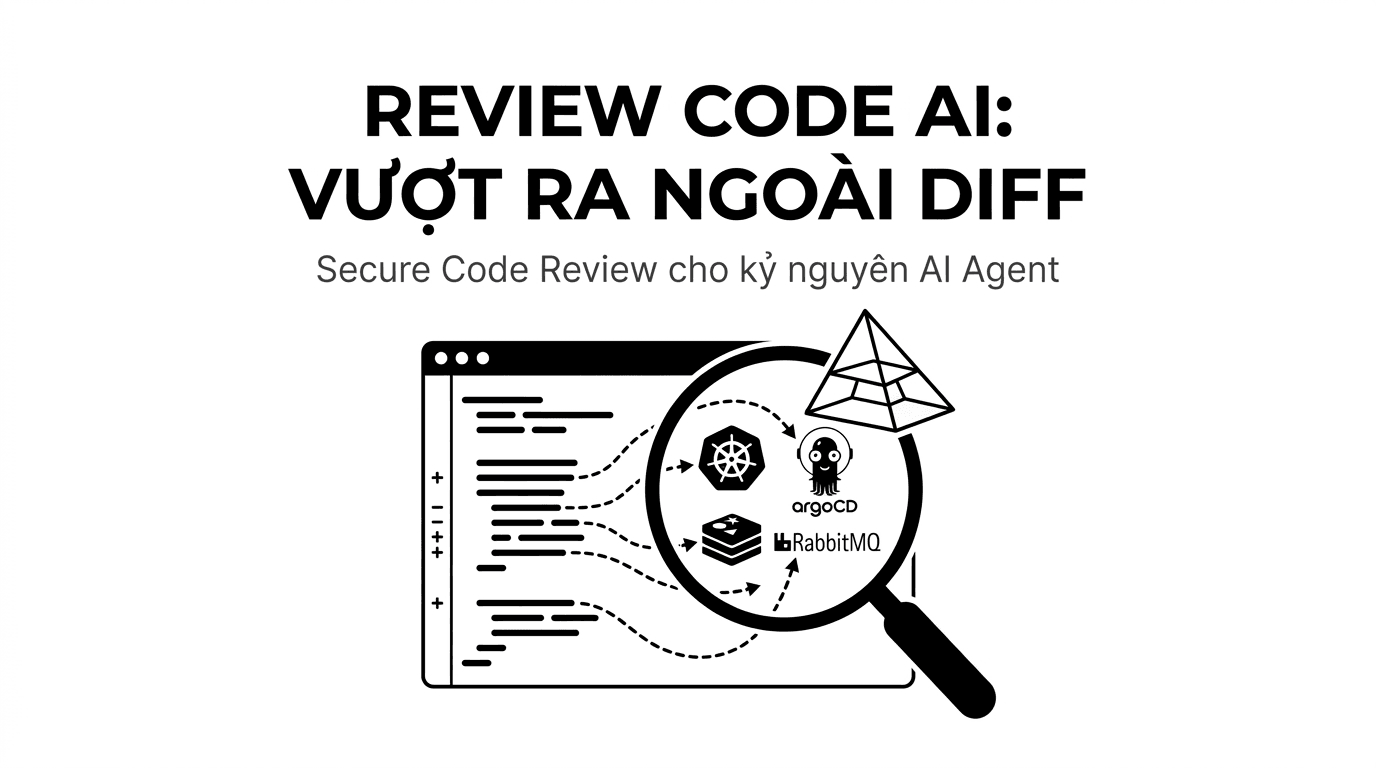

blogsSecure code review cho code do AI agent tạo ra (updated to 2026)

Code do AI agent tạo ra cần được review như một phần của Secure SDLC, không chỉ như thao tác đọc diff trong pull request. Quy trình review phải kiểm tra đồng thời logic bảo mật, tác động thiết kế, side effects ngoài phạm vi task, test bảo mật, CI/CD gate và bằng chứng vận hành. Các case study cho thấy từng thay đổi sai của agent có thể được ánh xạ trực tiếp tới checklist, giúp reviewer phát hiện lỗi có hệ thống trước khi merge hoặc deploy.

blogs

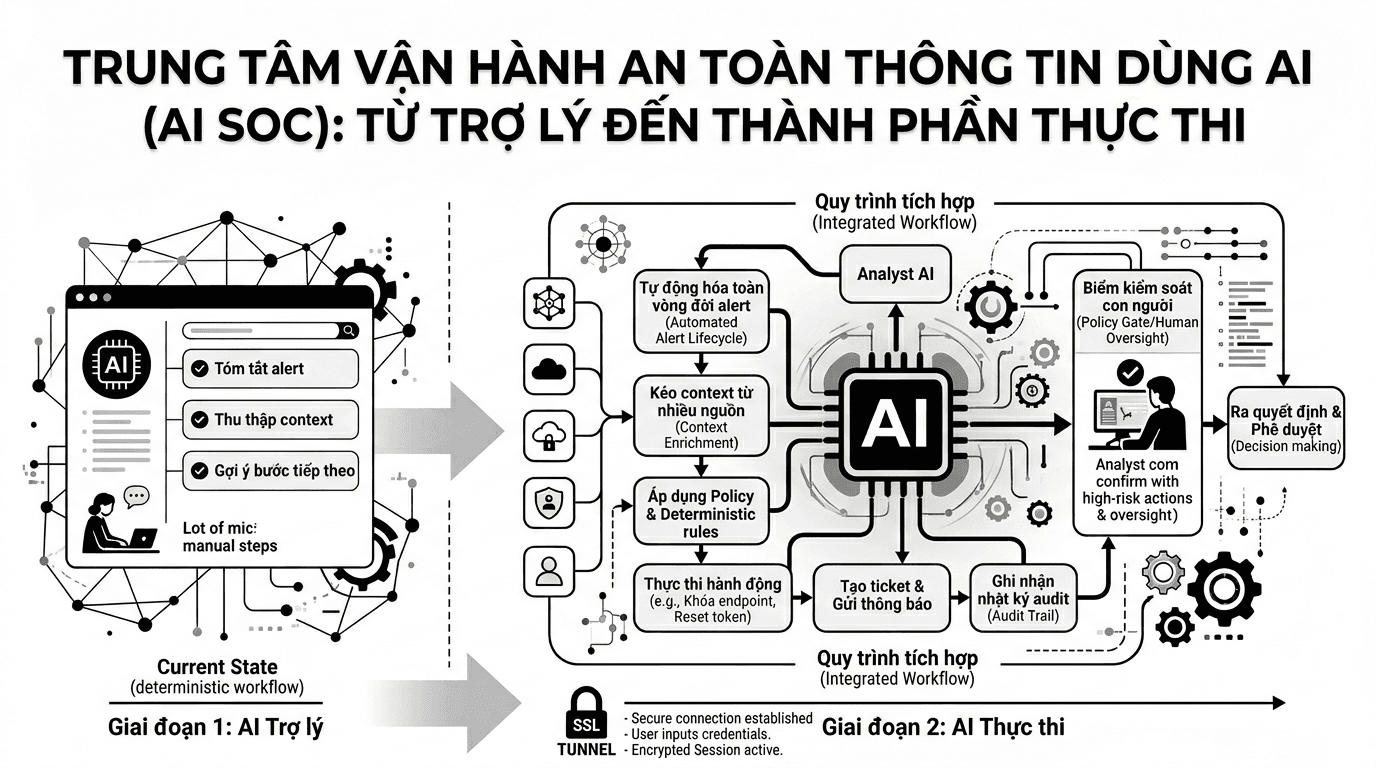

blogsAI SOC không nằm ở chỗ hiểu alert nhanh hơn, mà ở chỗ xử lý được công việc đến cùng

Nhiều hệ thống AI SOC hiện nay mới chỉ giúp analyst đọc alert nhanh hơn, gom context nhanh hơn và viết tóm tắt đẹp hơn. Giá trị thực chỉ xuất hiện khi AI đi vào workflow, thực hiện được các bước xử lý có kiểm soát, phối hợp được nhiều công cụ, ghi lại đầy đủ dấu vết và chỉ đẩy con người vào các điểm cần phán đoán hoặc phê duyệt.

blogs

blogsChạy Gemma 4 26B Cục Bộ với LM Studio 0.4.0 và Kết Nối Claude Code Offline

Chạy model ngôn ngữ lớn 26 tỷ tham số trên laptop cá nhân từng là điều không tưởng. Với Gemma 4 26B-A4B và LM Studio 0.4.0, điều đó giờ chỉ cần một lệnh terminal và 48 GB RAM. Bài viết phân tích tại sao kiến trúc Mixture-of-Experts cho phép Gemma 4 đạt Elo 1441 cạnh tranh với các model 400 tỷ tham số, cách daemon headless llmster biến LM Studio thành inference server chạy hoàn toàn không cần GUI, và đặc biệt là cách kết nối Claude Code với Gemma 4 qua endpoint tương thích Anthropic để có môi trường lập trình AI hoàn toàn offline. Kèm theo là phân tích bộ nhớ chi tiết theo từng ngưỡng context window, lý do không nên bật speculative decoding với MoE, và con số thực tế: 51 token mỗi giây cho chat độc lập, giảm còn khoảng 28 khi chạy qua Claude Code.

blogs

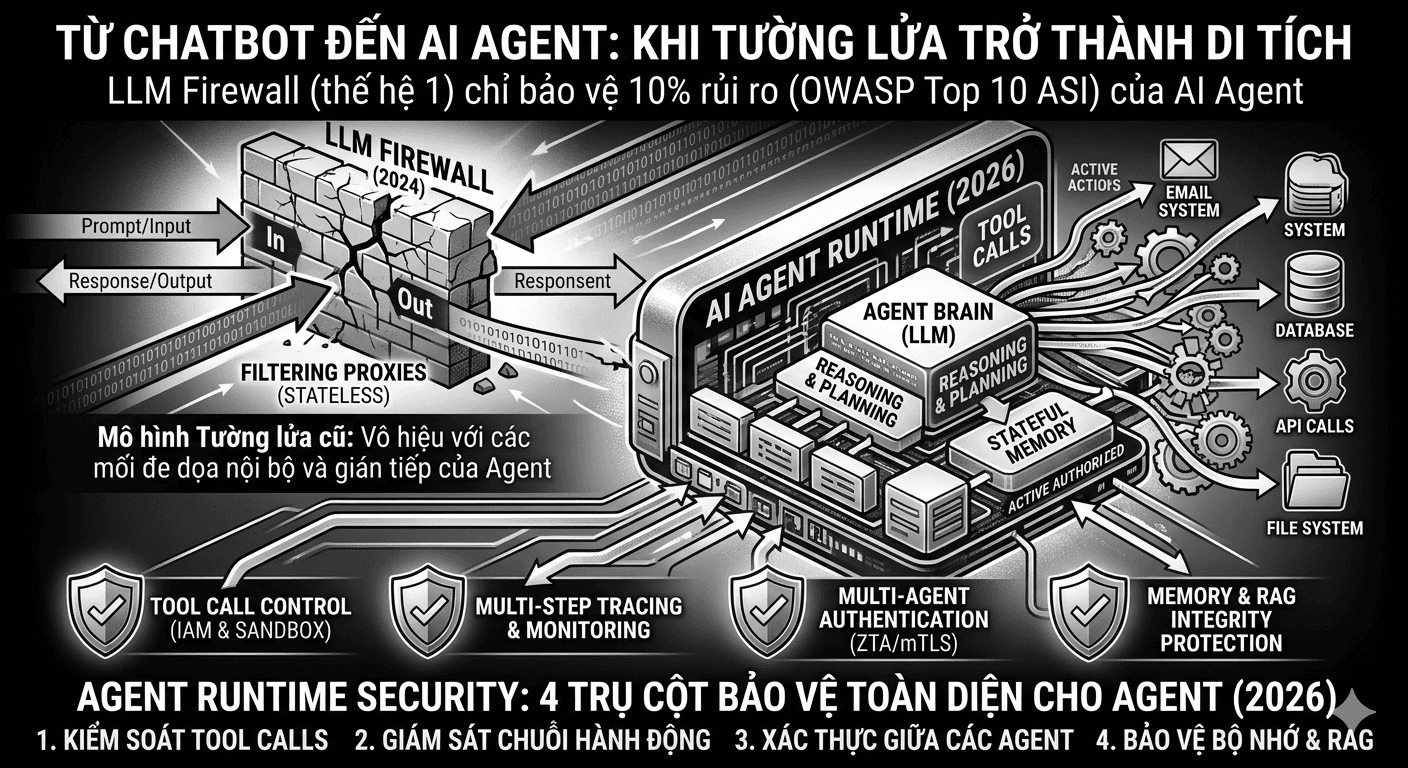

blogsLLM Firewall Lỗi Thời Trước Khi Kịp Ra Đời: Vì Sao Bảo Vệ Chatbot Không Còn Đủ Trong Thế Giới AI Agent

LLM Firewall không phải là sản phẩm tệ. Nó là sản phẩm đúng cho đúng thời điểm, nhưng thời điểm đó đã qua. Với bất kỳ tổ chức nào đang triển khai AI agent trong môi trường thực tế, câu hỏi không còn là "có nên bảo mật AI không" mà là "công cụ bảo mật mình đang dùng có được thiết kế cho đúng bài toán không".

blogs

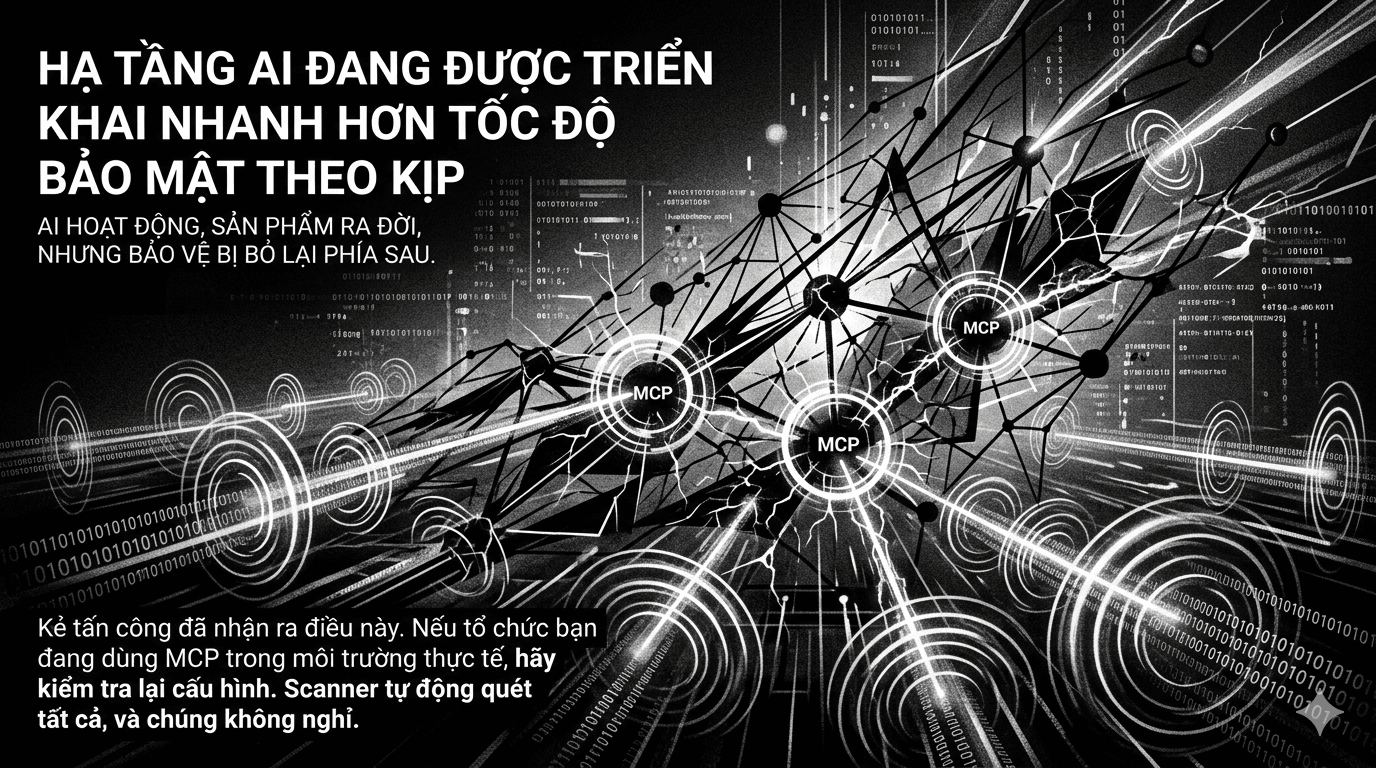

blogsChuyện Gì Xảy Ra Khi Hệ Thống Trí Tuệ Nhân Tạo Không Có Khóa Cửa?

Hạ tầng AI đang được triển khai nhanh hơn nhiều so với tốc độ mà cộng đồng bảo mật có thể theo kịp. Các đội ngũ kỹ thuật tập trung vào việc làm cho AI hoạt động, làm cho sản phẩm ra đời nhanh, và phần bảo vệ bị bỏ lại phía sau. Kẻ tấn công nhận ra điều này sớm hơn nhiều người nghĩ. Nếu tổ chức bạn đang dùng MCP trong môi trường thực tế, đây là thời điểm để kiểm tra lại cấu hình. Không phải vì ai đó đang nhắm vào bạn cụ thể, mà vì các scanner tự động không cần nhắm vào ai cụ thể. Chúng quét tất cả, và chúng không nghỉ.

blogs

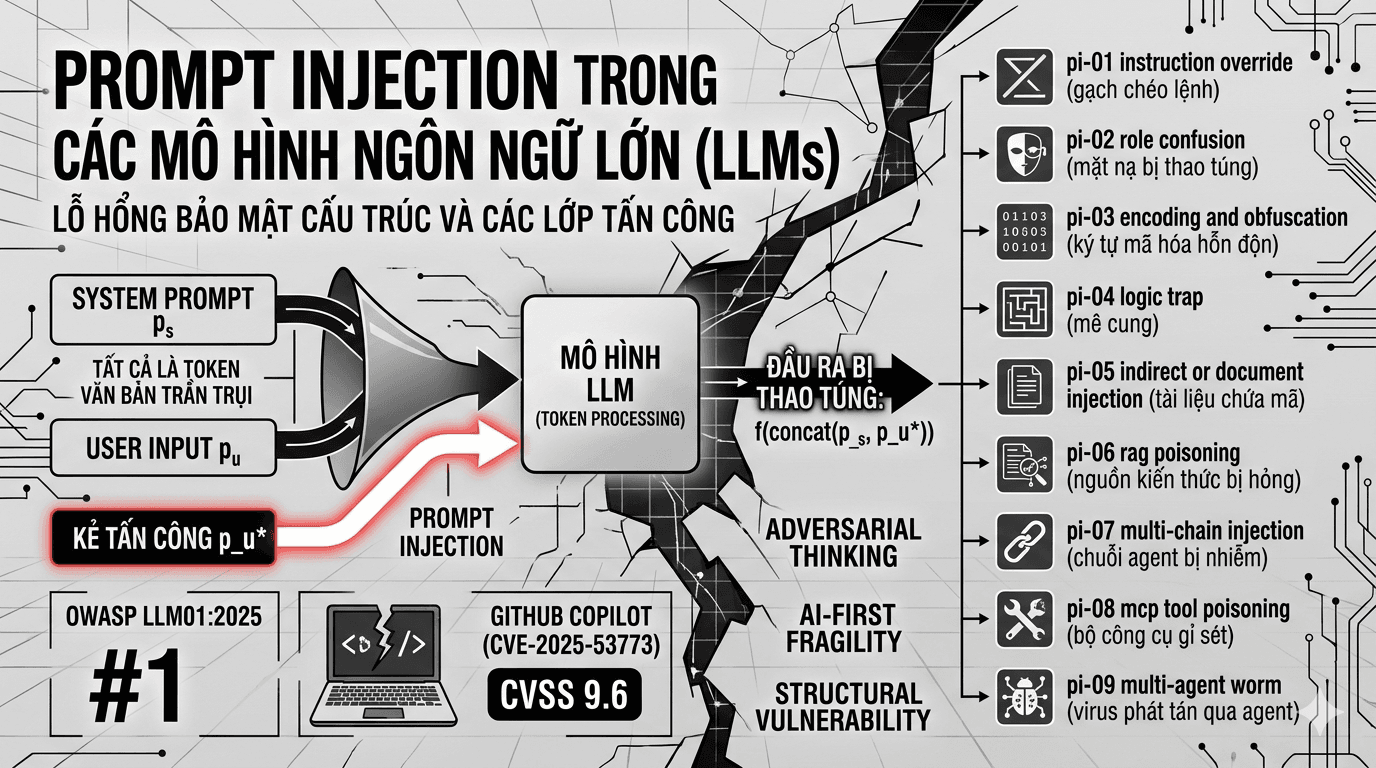

blogsTấn công Prompt Injection vào các Mô hình Ngôn ngữ Lớn

Tấn công Prompt Injection (PI) vào các Mô hình Ngôn ngữ Lớn đã được OWASP xếp hạng là lỗ hổng bảo mật số một (LLM01:2025) trong danh sách OWASP Top 10 cho Ứng dụng LLM năm 2025. Phân tích cho thấy rằng mặc dù các cơ chế phòng thủ hiện tại ngày càng tinh vi, các cuộc tấn công thích ứng (adaptive attacks) vẫn có thể vượt qua hơn 90% các biện pháp phòng thủ được công bố. Điều này phản ánh một nghịch lý kiến trúc cơ bản: LLM không có khả năng phân biệt "dữ liệu" và "lệnh" ở cấp độ cú pháp tất cả đều là văn bản thuần túy.