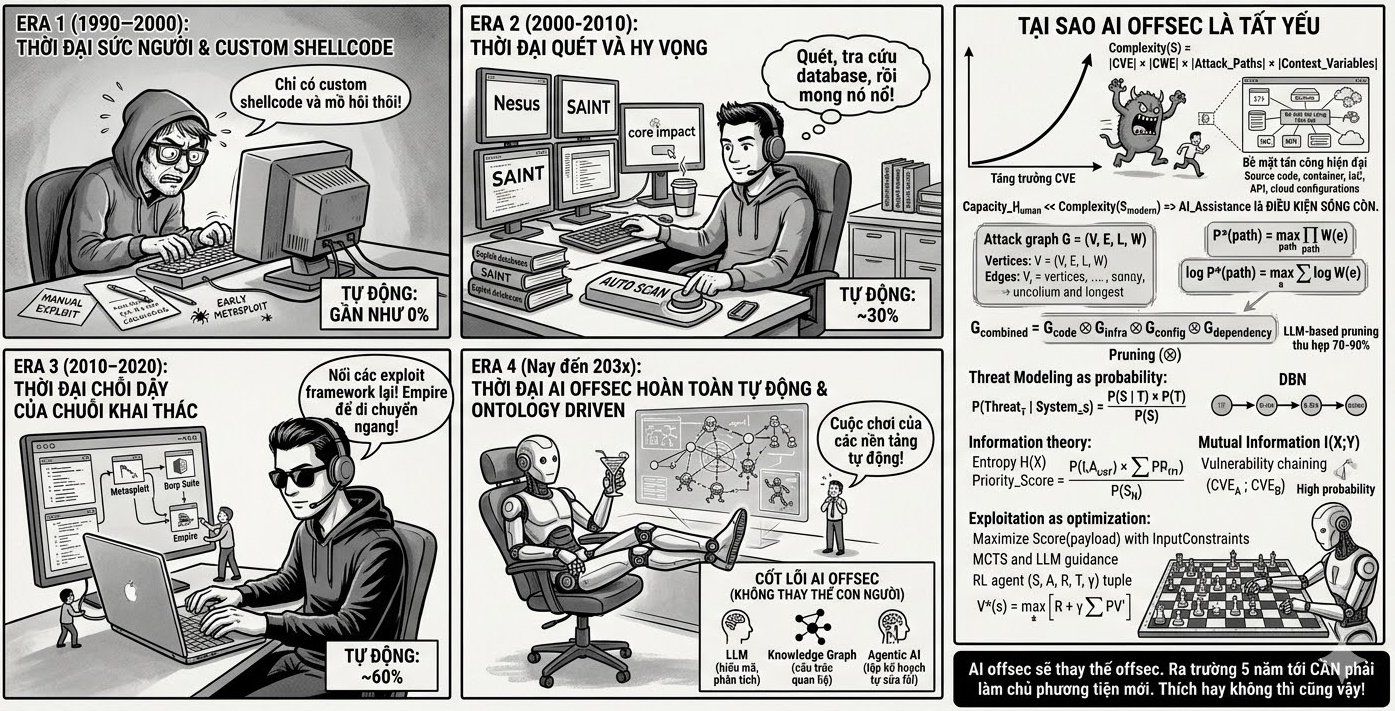

lịch sử offensive security có thể được phân kỳ thành bốn thời đại phát triển rõ rệt, mỗi thời đại được đặc trưng bởi mức độ tự động hóa và trừu tượng hóa tăng dần trong quá trình tấn công và phòng thủ.

1990–2000 : khai thác thủ công chủ yếu sử dụng các custom shellcode, early metasploit.

2000-2010: khai thác tự động với các công cụ auto scan và các exploit databases như Nesus, SAINT, core impact, tự động khoảng 30%.

2010 - 2020: bắt đầu rộ lên với các chaining exploits framework, như metasploit, burp suite, empire, mức tự động khoảng 60%.

giai đoạn từ nay tới 203x, sẽ là sự bùng nổ của fully autonomous exploitation và ontology driven, về cơ bản cuộc chơi offensive security sẽ là cuộc đua của các nền tảng tự động. ~95% workload sẽ được tự động hóa là điều chắc chắn.

để hiểu tại sao AI Offsec không phải là một lựa chọn mà là một tất yếu, cần xem xét sự tương quan giữa độ phức tạp của bề mặt tấn công và khả năng nhận thức của con người theo thời gian.

Complexity(S) = |CVE| × |CWE| × |Attack_Paths| × |Context_Variables|

số lượng CVE được công bố đã tăng tăng trưởng hàm mũ. bề mặt tấn công hiện đại bao gồm source code, container images, IaC templates, api specifications, cloud configurations khi được tổng hợp lại tạo ra một không gian tìm kiếm mà ko một thằng người hay nhóm nhỏ nào có thể khảo sát đầy đủ.

Capacity_Human << Complexity(S_modern) => AI_Assistance là điều kiện sống còn.

hãy nhớ trong engineering bài toán tổ hợp luôn là bài toán bóp chết mọi manual effort của con người.

tất nhiên, điều này ko có nghĩa là AI thay thế hoàn toàn con người (ko hiểu mỗi lần viết về AI tôi cứ phải cho cái câu này vào vì sợ một số bộ não với nhận thức sơ sài có thể bị tác động tiêu cực ![]() ). thay vào đó, nó xác lập một nguyên lý cơ bản: trong tương lai gần, mọi quy trình kiểm thử bảo mật đều phải tích hợp AI như một thành phần cốt lõi. ko phải là thứ nói chơi chơi.

). thay vào đó, nó xác lập một nguyên lý cơ bản: trong tương lai gần, mọi quy trình kiểm thử bảo mật đều phải tích hợp AI như một thành phần cốt lõi. ko phải là thứ nói chơi chơi.

AI Offsec là sản phẩm của sự hội tụ ba dòng công nghệ độc lập nhưng cùng chín muồi (tới hiện tại). sự hội tụ này tạo ra một paradigm hoàn toàn mới mà trước đây ko thể có được.

LLM (Large Language Model): Khả năng hiểu và sinh code, phân tích ngữ nghĩa của hàng triệu token source code, đọc hiểu documentation, cve descriptions, exploit writeups. LLM mang lại khả năng suy luận ngôn ngữ tự nhiên về bảo mật. đây là một kỹ năng trước đây chỉ con người mới có.

knowledge graph & ontology (KG): khả năng biểu diễn cấu trúc quan hệ phức tạp giữa các thực thể bảo mật: CVE --> CWE --> attack pattern --> affected component --> mitigation. KG là long-term structured cho AI Offsec.

agentic AI systems: Khả năng lập kế hoạch multi-step, sử dụng công cụ (tools), tự sửa lỗi, và thực hiện các tác vụ dài hạn mà ko cần sự giám sát liên tục của con người.

toàn bộ khung này hoàn toàn được kiểm chứng lý thuyết là khả thi

một attack graph G = (V, E, L) là cấu trúc toán học nền tảng của AI Offsec. các thành phần được định nghĩa :

V: tập hợp các đỉnh đại diện cho trạng thái hệ thống hoặc điều kiện tấn công. mỗi đỉnh v ∈ V mã hóa trạng thái mạng, credentials đã thu thập, và services đã compromise.

E ⊆ V × V: tập hợp các cạnh đại diện cho các bước chuyển trạng thái. mỗi cạnh (u,v) ∈ E tương ứng với một exploit action đưa system từ trạng thái u sang v.

W: E --> [0,1]: hàm trọng số xác suất thành công của mỗi exploit step.

L: V --> {0,1}: hàm nhãn xác định đỉnh đích (fully compromised state).

G_attack = (V_states, E_exploits, L_compromise, W_probability)

bài toán cốt lõi trong attack graph analysis là tìm đường đi có xác suất thành công cao nhất từ trạng thái ban đầu s₀ đến trạng thái mục tiêu sₜ. đây là bài toán maximum probability path:

P*(path) = max_{path: s₀ -->* sₜ} ∏_{e ∈ path} W(e)

lấy logarithm tự nhiên để chuyển bài toán nhân thành bài toán cộng, cho phép áp dụng bất kỳ shortest path nào để giải như dijkstra/bellman-ford:

log P*(path) = max ∑_{e ∈ path} log W(e)

AI Offsec tự động xây dựng attack graph bằng cách hợp nhất thông tin từ nhiều nguồn:

SCA: Phân tích AST và DFG để trích xuất luồng dữ liệu, authentication boundaries, và các điểm vào/ra của ứng dụng.

IaC Template Parsing: terraform/cloudformation được parse để xây dựng topology mạng, security groups, IAM policies.

api specification: openapi/swagger specs cung cấp đầy đủ attack surface của rest/graphql endpoints.

dependency analysis: SBOM xác định vulnerable third-party libraries.

G_combined = G_code ⊗ G_infra ⊗ G_config ⊗ G_dependency

Phép toán ⊗ ở đây là graph composition: tạo cross-product của các đồ thị thành phần, sau đó prune các cạnh ko khả thi về mặt connectivity thực tế.

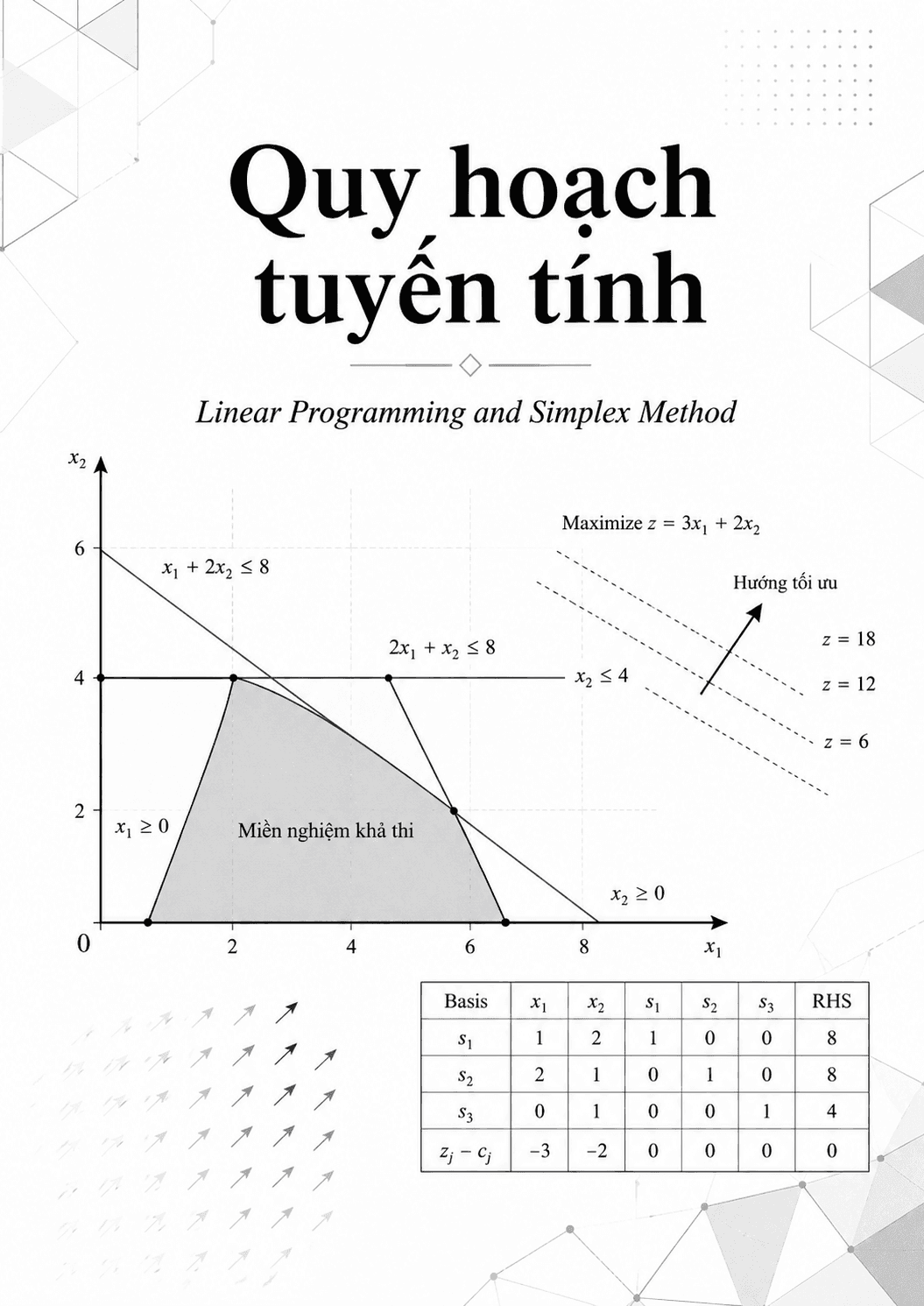

bài toán tìm đường tấn công tối ưu trong attack graph tổng quát là np-hard (thuộc class PSPACE). tuy nhiên, trong thực tế, các attack graph có cấu trúc directed acyclic hraph) cho phép giải bằng quy hoạch động trong thời gian tuyến tính:

MaxProb(v) = max_{u: (u,v)∈E} [ MaxProb(u) × W(u,v) ]

Với LLM-based pruning, không gian tìm kiếm được thu hẹp 70-90% bằng cách loại bỏ các đường tấn công ko khả thi về mặt ngữ nghĩa. đây là một lợi thế mà các heuristic thuần túy ko thể đạt được. LLM có thể đánh giá liệu exploit A có thực sự dẫn đến condition B trong ngữ cảnh cụ thể này ko? một câu hỏi đòi hỏi semantic reasoning.

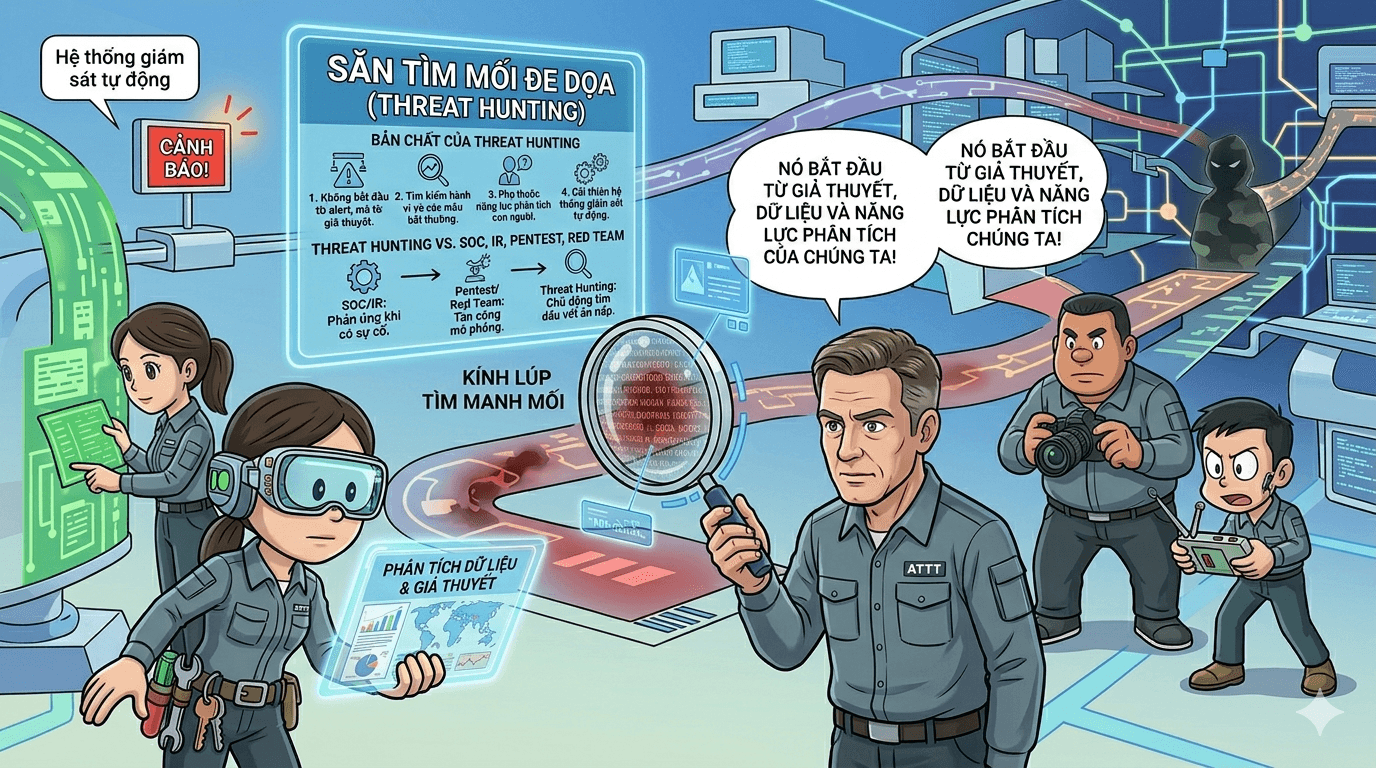

threat modeling ( thường nhắc tới: 4 questions,STRIDE, PASTA, LINDDUN) chủ yếu là định tính và phụ thuộc nhiều vào expertise của người thực hiện. AI Offsec biến threat modeling thành một bài toán xác suất , loại bỏ sự phụ thuộc vào intuition:

P(Threat_T | System_S) = P(S | T) × P(T) / P(S)

diễn giải: P(T) là xác suất prior của loại threat T dựa trên lịch sử CVE trong cùng technology stack. P(S|T) là likelihood của cấu hình hệ thống S nếu threat T tồn tại. P(T|S) là posterior probability là xác suất có threat T trong hệ thống cụ thể S sau khi quan sát cấu hình.

trong thực tế, AI Offsec thu thập prior data từ NVD statistics, bug bounty reports, và pentest findings databases để có P(T) có căn cứ thực nghiệm, thay vì estimate chủ quan.

thực tế một attack chain trong thực tế luôn là các bước phụ thuộc nhau. dynamic bayesian betwork (DBN) cho phép mô hình hóa điều này một cách tự nhiên:

P(A₁, A₂, ..., Aₙ) = P(A₁) × ∏ᵢ₌₂ⁿ P(Aᵢ | Aᵢ₋₁, Context_i)

AI Offsec sử dụng DBN để dự đoán attack chain có xác suất cao nhất trong ko gian tấn công của target, thay vì kiểm tra toàn bộ không gian theo cách brute force. DBN cũng cho phép cập nhật bayesian online: khi một bước tấn công thành công hoặc thất bại, toàn bộ posterior được cập nhật để reflect thông tin mới.

lý thuyết thông tin cung cấp công cụ đo lường mức độ ko chắc chắn của hệ thống từ góc độ attacker với một metric quan trọng để ưu tiên test coverage:

H(X) = -∑ᵢ p(xᵢ) × log₂(p(xᵢ))

trong ngữ cảnh cybersecurity, H(Attack_Surface) đo lường độ phong phú và phân tán của attack surface. một hệ thống với nhiều endpoint, nhiều component, và nhiều integration có entropy cao hơn thì sẽ cần nhiều test resources hơn. AI Offsec sử dụng entropy để phân bổ test budget một cách tối ưu: ưu tiên các subsystem có entropy cao nhất (rich attack surface) và severity cao nhất.

Priority_Score(component) = H(component) × Severity(component) × Business_Value(component)

mutual information I(X;Y) đo lường mức độ một lỗ hổng X thông báo về sự tồn tại của lỗ hổng Y. đây là nền tảng toán học cho vulnerability chaining là kỹ năng quan trọng nhất của attacker giỏi:

I(CVE_A ; CVE_B) = H(CVE_A) + H(CVE_B) - H(CVE_A, CVE_B)

nếu I(SQLi ; IDOR) cao trong historical data, thì khi phát hiện SQL Injection tại một endpoint, AI Offsec sẽ tự động ưu tiên tìm kiếm IDOR ở các endpoint liên quan. điều này phản ánh cách một hacker kinh nghiệm thực sự tư duy: nếu tôi tìm thấy X, rất có khả năng Y cũng tồn tại ở đây.

việc tìm kiếm một exploit hợp lệ có thể được hình thức hóa như bài toán tối ưu hóa trong ko gian tham số liên tục:

maximize: Score(payload) = Effectiveness(payload) × Reliability(payload) × Stealth(payload)

subject to: payload ∈ InputConstraints(target_function, protocol)

với kỹ thuật monte carlo tree search (MCTS) kết hợp với LLM-guided rollout, ko gian này được khám phá hiệu quả hơn nhiều so với fuzzing thuần túy. LLM cung cấp prior knowledge để định hướng search về những vùng có nhiều khả năng chứa exploit hợp lệ.

cuối cùng, một RL agent cho AI Offsec được định nghĩa bởi tuple (S, A, R, T, γ):

S (state space): trạng thái hiện tại của quá trình exploitation chứa credentials đã thu thập, services đã discover, shell đã có, network topology đã map được.

A (action space): các exploit action có thể thực hiện tại mỗi trạng thái, bao gồm scanning, exploitation, lateral movement, và exfiltration.

R (reward function): điểm thưởng khi đạt được mục tiêu: +100 cho RCE, +80 cho privilege escalation, +60 cho data exfiltration, -10 cho mỗi failed attempt (giảm stealth).

T (transition function): xác suất chuyển sang trạng thái mới sau mỗi action, phụ thuộc vào target's defenses.

γ (discount factor): ưu tiên exploit nhanh (γ thấp) hay exploit thorough (γ cao).

V*(s) = max_a [ R(s,a) + γ × ∑_{s'} T(s,a,s') × V*(s') ]

nguyên lý này giống hệt cách mà con bot AlphaGo học chơi cờ vây nhưng thay vì board game, ko gian là mạng máy tính đích và mục tiêu là compromise thành công với stealth tối đa.

cơ sở này khẳng định chắc nịch, AI offsec sẽ thay thế thuật ngữ offsec. ra trường trong khoảng 5 năm tới, cần phải làm chủ những phương tiện lao động mới này. thích hay ko thích thì cũng vậy thôi.