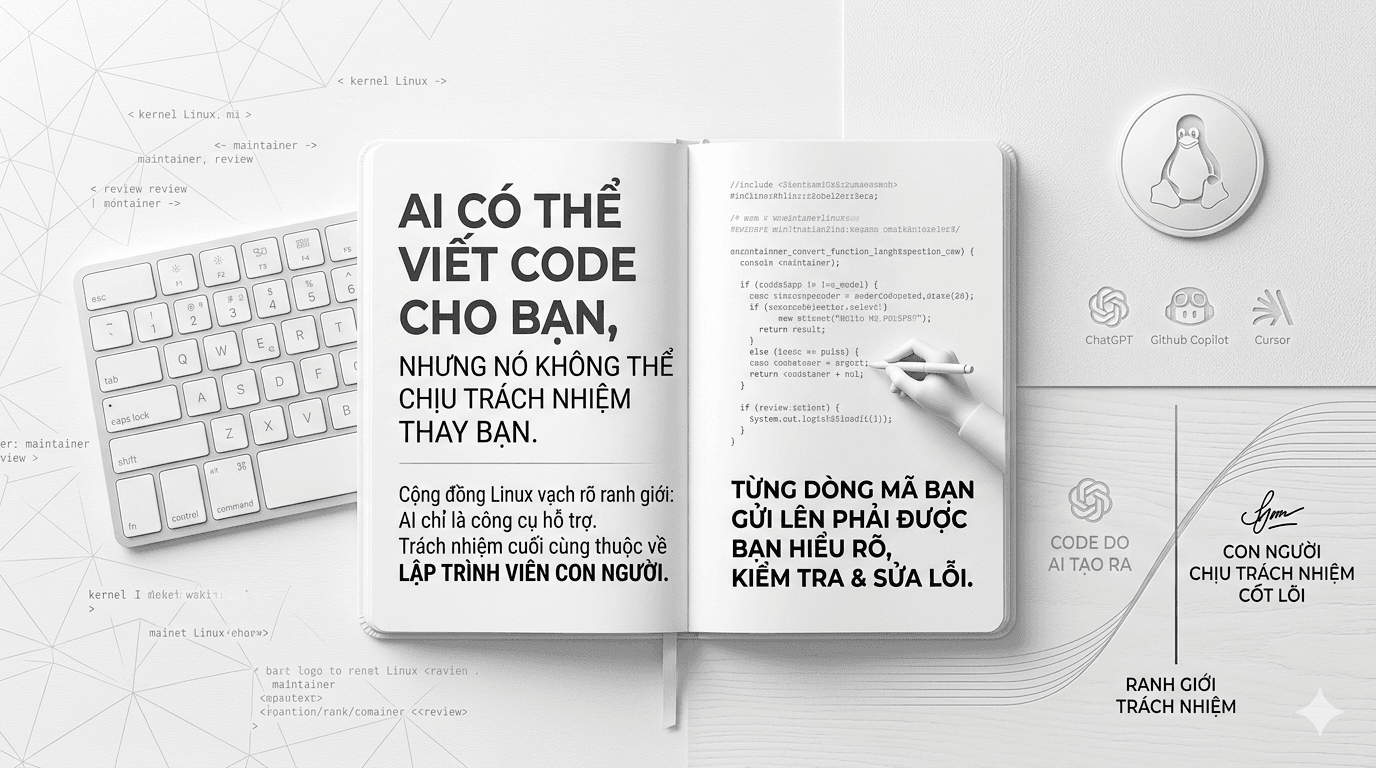

AI có thể viết code cho bạn, nhưng nó không thể chịu trách nhiệm thay bạn. Cộng đồng phát triển Linux vừa làm rõ điều đó một cách dứt khoát, gần như không để lại vùng xám nào cho sự ngộ nhận. Sau nhiều tháng tranh luận, họ đã vạch ra một ranh giới rõ ràng: các công cụ AI như Claude, Cursor, Codex, Antigravity, GitHub Copilot, ChatGPT,… có thể được sử dụng, nhưng những đoạn mã “rác do AI tạo ra” với chất lượng thấp sẽ không bao giờ được chấp nhận trong kernel.

Nguyên tắc cốt lõi rất đơn giản nhưng cực kỳ quan trọng: con người là người chịu trách nhiệm cuối cùng cho mọi sai sót. Điều này có nghĩa là dù bạn có sử dụng AI để hỗ trợ viết code hay không, thì từng dòng mã bạn gửi lên vẫn phải được bạn hiểu rõ, kiểm tra, sửa lỗi và duy trì như bất kỳ đóng góp nào khác. Không có chuyện sao chép mù quáng, không có chuyện “đổ lỗi cho AI”. Trách nhiệm không thể bị outsource.

Nếu nhìn sâu hơn, đây không chỉ là một quy định kỹ thuật, mà là một tuyên bố mang tính triết lý về bản chất của kỹ nghệ phần mềm. Từ góc nhìn của người tạo ra nhân hệ điều hành Linux - Linus Torvalds - vấn đề không nằm ở việc AI có viết code tốt hay không, mà nằm ở chỗ code đó có được đặt trong một hệ thống trách nhiệm rõ ràng hay không. Với kernel Linux, mỗi dòng code không chỉ là logic, nó là một phần của một hệ thống vận hành hàng trăm triệu máy tính, server, thiết bị trên toàn cầu. Một lỗi nhỏ có thể gây ra hậu quả lớn. Trong một hệ thống như vậy, “không ai chịu trách nhiệm” là điều không thể chấp nhận.

AI, về bản chất, là một hệ thống xác suất. Nó không “hiểu” code theo nghĩa mà một lập trình viên hiểu. Nó không có ý thức về hậu quả, không có trách nhiệm với hệ thống, và cũng không có động lực để sửa sai. Nó chỉ tối ưu hóa đầu ra dựa trên dữ liệu đã học. Điều này tạo ra một khoảng cách rất lớn giữa việc “tạo ra code” và “chịu trách nhiệm cho code”. Linux không cấm AI, nhưng họ từ chối việc để khoảng cách này trở thành một lỗ hổng.

Một điểm quan trọng khác là chất lượng. Trong cộng đồng kernel, code không chỉ cần chạy được, mà phải rõ ràng, tối ưu, dễ bảo trì và phù hợp với triết lý thiết kế chung. Những đoạn code do AI sinh ra, nếu không được kiểm soát, thường có xu hướng “có vẻ đúng” nhưng thiếu chiều sâu về thiết kế. Chúng có thể giải quyết vấn đề trước mắt, nhưng lại tạo ra nợ kỹ thuật dài hạn. Từ góc nhìn của một người như Linus, đây là điều đặc biệt nguy hiểm. Ông luôn nhấn mạnh rằng code tốt không chỉ là code chạy được, mà là code mà người khác có thể đọc, hiểu và tiếp tục phát triển sau này.

Việc cho phép sử dụng AI nhưng yêu cầu trách nhiệm tuyệt đối từ con người thực chất là một cách giữ cân bằng. Nó thừa nhận rằng AI có thể tăng năng suất, nhưng đồng thời đặt ra một rào chắn để ngăn việc suy giảm chất lượng hệ thống. Đây là một cách tiếp cận rất thực dụng: không cực đoan phủ nhận công nghệ mới, nhưng cũng không ngây thơ tin rằng công nghệ đó có thể thay thế vai trò cốt lõi của con người.

Nếu phân tích sâu hơn, quyết định này còn phản ánh một vấn đề lớn hơn trong ngành phần mềm hiện nay: sự nhầm lẫn giữa tốc độ và năng lực. AI khiến việc viết code trở nên nhanh hơn, nhưng nó không làm cho người viết hiểu hệ thống tốt hơn. Trong nhiều trường hợp, nó còn tạo ra ảo giác về năng lực, khi lập trình viên cảm thấy mình “làm được nhiều hơn” mà không thực sự kiểm soát được những gì mình đang tạo ra. Linux, với tiêu chuẩn cực kỳ khắt khe của mình, đã từ chối ảo giác này.

Một cách nhìn khác là: AI làm giảm chi phí tạo ra code, nhưng không làm giảm chi phí hiểu và bảo trì code. Trong một hệ thống lớn như kernel, chi phí thứ hai luôn lớn hơn rất nhiều. Vì vậy, nếu AI làm tăng lượng code mà không tăng tương ứng mức độ hiểu, thì tổng chi phí hệ thống sẽ tăng, không giảm. Quy định của Linux thực chất là một cơ chế để giữ cho hai yếu tố này cân bằng.

Từ góc độ giáo dục và phát triển kỹ sư, thông điệp này cũng rất rõ ràng. Người giỏi trong thời đại AI không phải là người dùng AI nhiều nhất, mà là người có thể kiểm soát được những gì AI tạo ra. Điều đó đòi hỏi một nền tảng rất vững về lập trình, hệ thống và tư duy. AI không thay thế những thứ đó, nó chỉ làm lộ rõ ai có và ai không.

Cuối cùng, câu nói “AI chỉ là công cụ, trách nhiệm thuộc về con người” nghe có vẻ hiển nhiên, nhưng trong bối cảnh hiện nay, nó mang ý nghĩa rất lớn. Khi công nghệ ngày càng mạnh, cám dỗ để giao phó trách nhiệm cho máy móc cũng ngày càng lớn. Linux đã chọn một con đường khác: giữ trách nhiệm ở nơi nó thuộc về. Và chính điều đó giúp hệ thống của họ tồn tại, phát triển và đáng tin cậy suốt hàng chục năm qua.

#artificialintelligence#Linux#opensource#programming#SoftwareEngineering#coding#GitHubCopilot#ClaudeAI#Codex#ChatGPT#nợKỹThuậtDàiHạn

Đọc thêm: https://lwn.net/Articles/1049830/