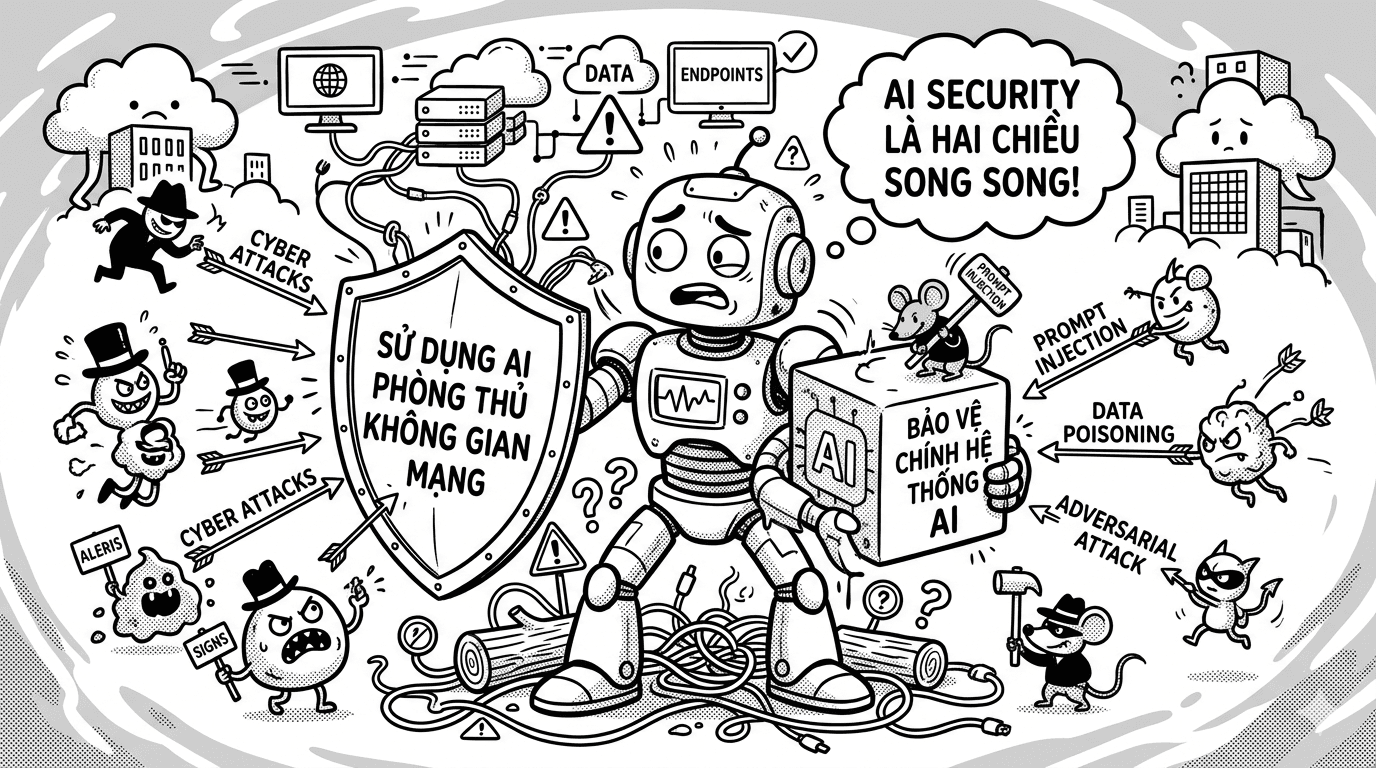

Khi nhắc đến bảo mật AI (AI security), nhiều người thường chỉ nghĩ đến việc bảo vệ các mô hình AI khỏi bị tấn công. Cách hiểu đó đúng nhưng chưa đủ. Ở góc nhìn rộng hơn, AI security là toàn bộ nỗ lực sử dụng trí tuệ nhân tạo (Artificial Intelligence, AI) để tăng cường an ninh mạng, đồng thời bảo vệ chính những hệ thống AI đang được đưa vào vận hành. Nói cách khác, đây là một lĩnh vực có hai chiều song song. Chiều thứ nhất là dùng AI như một công cụ phòng thủ. Chiều thứ hai là kiểm soát các rủi ro do AI tạo ra hoặc phải gánh chịu. Chính vì có hai chiều này nên AI security trở thành một chủ đề đặc biệt quan trọng trong thời kỳ số hóa hiện nay.

Sở dĩ chủ đề này nổi lên mạnh là vì môi trường công nghệ ngày càng phức tạp. Dữ liệu không còn nằm trong một hệ thống tập trung mà phân tán qua cloud, hybrid cloud, thiết bị đầu cuối, ứng dụng web, API và nhiều dịch vụ bên thứ ba. Khối lượng log, sự kiện, hành vi truy cập và cảnh báo bảo mật tăng đến mức con người khó có thể theo dõi đầy đủ bằng các quy trình thủ công. Trong bối cảnh đó, AI trở thành công cụ giúp tổ chức quan sát nhanh hơn, xử lý nhiều dữ liệu hơn và phản ứng sớm hơn trước các dấu hiệu bất thường. Đồng thời, chính AI cũng mở ra một bề mặt tấn công mới mà tổ chức không thể xem nhẹ.

Bản chất của AI Security

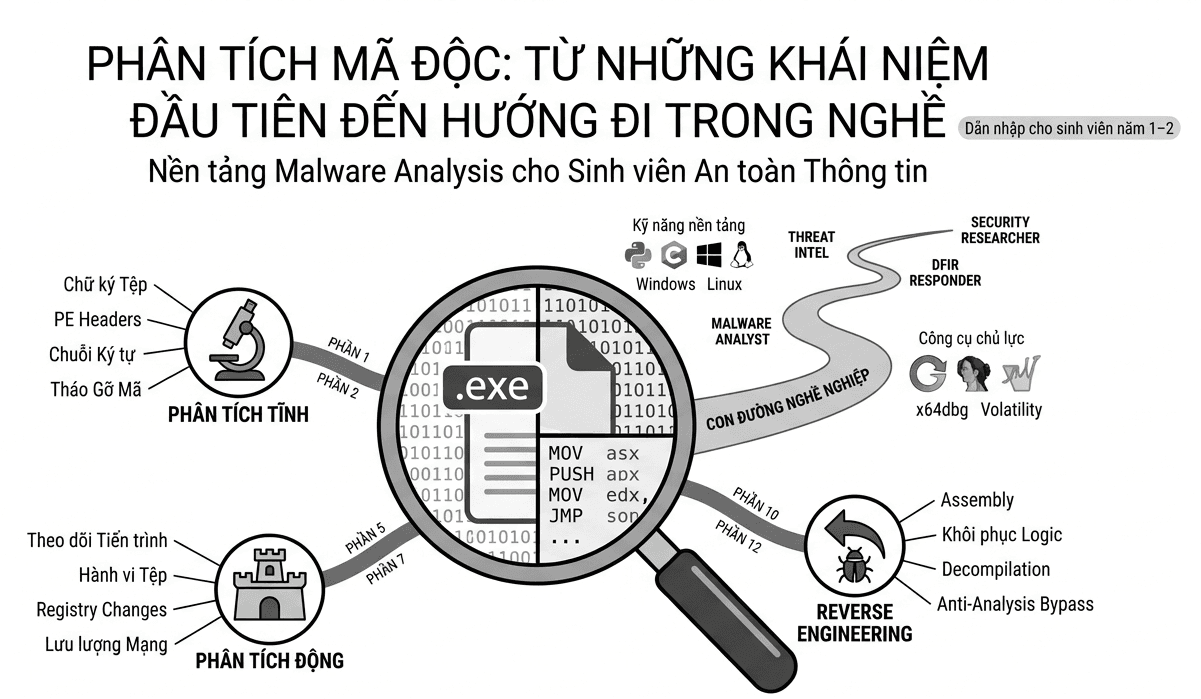

Nếu diễn giải theo cách dễ hiểu, AI security là việc đưa AI vào trong chu trình phòng thủ số để hỗ trợ phát hiện mối đe dọa, ngăn chặn hành vi nguy hiểm, hỗ trợ xử lý sự cố và cải thiện khả năng ra quyết định của đội bảo mật. Nền tảng kỹ thuật thường gặp ở đây là học máy (Machine Learning, ML), học sâu (Deep Learning) và AI tạo sinh (Generative AI, gen AI). Những công nghệ này giúp hệ thống đọc được lượng dữ liệu rất lớn như xu hướng lưu lượng mạng, kiểu sử dụng ứng dụng, thói quen truy cập và các tín hiệu bất thường trong toàn bộ hạ tầng số.

Điểm mạnh quan trọng của cách tiếp cận này nằm ở khả năng xây dựng đường cơ sở bảo mật (security baseline). Hệ thống quan sát một khoảng thời gian đủ dài để hiểu điều gì là bình thường đối với người dùng, ứng dụng và mạng. Sau đó, bất kỳ hoạt động nào lệch đáng kể khỏi trạng thái bình thường đó đều có thể bị đánh dấu là dị thường (anomaly). Cách tiếp cận này hữu ích vì nhiều cuộc tấn công hiện đại không còn mang hình dạng cố định như các mẫu đã biết từ trước. Chúng thay đổi liên tục và thường được giấu trong những hành vi có vẻ hợp lệ. AI giúp phát hiện phần lệch này tốt hơn so với các phương pháp chỉ dựa vào quy tắc cứng hoặc chữ ký tấn công truyền thống.

Một điểm nữa cần nhấn mạnh là gen AI không chỉ dùng để phân tích dữ liệu mà còn hỗ trợ diễn giải dữ liệu bảo mật thành ngôn ngữ dễ hiểu hơn. Điều này có giá trị lớn trong thực tế vận hành, vì đội bảo mật thường phải đọc một lượng lớn log, cảnh báo và kết quả phân tích kỹ thuật. Khi AI có thể chuyển hóa thông tin đó thành khuyến nghị rõ ràng, tốc độ ra quyết định sẽ được cải thiện đáng kể.

Cần phân biệt AI security với Secure AI (Bảo vệ AI)

Một sai lầm phổ biến là gộp tất cả vấn đề liên quan đến AI vào cùng một khái niệm. Thực ra, có ít nhất hai bài toán cần tách riêng. Bài toán thứ nhất là dùng AI để tăng cường an ninh mạng. Bài toán thứ hai là bảo vệ chính các hệ thống AI khỏi bị lạm dụng, bị truy cập trái phép hoặc bị thao túng. Hai bài toán này có liên hệ chặt chẽ nhưng không trùng nhau. Nếu chỉ tập trung vào chiều thứ nhất, tổ chức có thể triển khai rất nhiều công cụ AI vào vận hành mà quên rằng dữ liệu huấn luyện, mô hình, tham số, thư viện phụ thuộc và quy trình triển khai của mình cũng cần được bảo vệ nghiêm ngặt.

Sự tách bạch này càng quan trọng hơn khi AI không chỉ là công cụ của bên phòng thủ mà còn là công cụ của bên tấn công. Các mô hình ngôn ngữ lớn có thể giúp tạo ra email phishing được cá nhân hóa hơn, tự nhiên hơn và khó nhận diện hơn. Ngoài ra, bản thân các hệ thống AI cũng tạo ra những bề mặt tấn công mới như prompt injection, adversarial attack, supply chain attack hay hiện tượng shadow AI, tức là nhân viên tự ý đưa công cụ AI vào xử lý công việc mà không qua kiểm soát chính thức. Nhiều tài liệu còn cho biết chỉ khoảng 24 phần trăm dự án gen AI hiện tại được bảo vệ đầy đủ. Con số đó cho thấy tốc độ đưa AI vào sử dụng đang vượt quá tốc độ xây dựng kiểm soát an toàn cho chính AI.

Vì sao AI security trở nên quan trọng?

Tầm quan trọng của AI security xuất phát từ ba sức ép đồng thời. Thứ nhất là hệ sinh thái công nghệ ngày càng phức tạp, nhất là sau khi nhiều tổ chức chuyển sang cloud và hybrid cloud, làm dữ liệu bị phân tán và bề mặt tấn công mở rộng. Thứ hai là tác nhân đe dọa liên tục đổi chiến thuật và khai thác các lỗ hổng mới. Thứ ba là tình trạng thiếu hụt nhân lực an ninh mạng vẫn rất rõ, với hơn 700.000 vị trí còn trống tại Mỹ theo số liệu được bài nguồn dẫn lại. Khi số việc cần làm tăng lên nhưng số người không đủ, các tổ chức buộc phải tìm cách tự động hóa và tăng cường năng lực phòng thủ bằng công nghệ.

Không chỉ áp lực về vận hành, còn có áp lực về chi phí. Chi phí trung bình toàn cầu để khắc phục một vụ vi phạm dữ liệu trong năm 2023 được nêu là 4,45 triệu USD. Những tổ chức áp dụng mạnh AI và tự động hóa bảo mật phát hiện và khống chế sự cố nhanh hơn trung bình 108 ngày, đồng thời tiết kiệm trung bình 1,76 triệu USD chi phí phản ứng. Ngược lại, các tổ chức không đầu tư AI security có chi phí vi phạm trung bình lên tới 5,36 triệu USD. Ngay cả mức đầu tư còn hạn chế cũng cho thấy mức chi phí thấp hơn rõ rệt so với nhóm không triển khai. Những con số này cho thấy AI security không chỉ là lựa chọn công nghệ mà còn là lựa chọn quản trị rủi ro và tối ưu tài chính.

Lợi ích thực sự của AI Trong an ninh mạng?

Lợi ích đầu tiên là phát hiện mối đe dọa nhanh hơn và chính xác hơn. AI có thể đọc dữ liệu thời gian thực trên quy mô lớn và nhận ra các dấu hiệu bất thường mà công cụ truyền thống dễ bỏ sót. Điều này đặc biệt hữu ích khi tấn công không lặp lại theo mẫu cũ, hoặc khi hành vi nguy hiểm được che giấu bên trong các giao dịch có vẻ hợp lệ.

Lợi ích thứ hai là rút ngắn thời gian phản ứng sự cố (incident response). Khi hệ thống phát hiện sớm, phân loại sớm và gợi ý hành động sớm, tổ chức có thể khoanh vùng mối đe dọa trước khi thiệt hại lan rộng. Tốc độ này là yếu tố sống còn trong các vụ xâm nhập, mã độc tống tiền hoặc lộ lọt dữ liệu.

Lợi ích thứ ba là nâng hiệu quả vận hành. Nhiều công việc trong trung tâm vận hành an ninh như sàng lọc cảnh báo, gom nhóm sự kiện, đối chiếu log hay chạy quy trình phản ứng lặp lại đều có thể được tự động hóa ở mức đáng kể. Điều đó vừa giảm tải cho chuyên gia, vừa giảm sai sót do con người, đồng thời cho phép đội bảo mật dành thời gian cho các nhiệm vụ cần tư duy sâu hơn như điều tra nguyên nhân gốc, phân tích chiến dịch tấn công hay lập kế hoạch phòng thủ dài hạn.

Lợi ích thứ tư là chuyển từ phòng thủ bị động sang phòng thủ chủ động. AI có thể học từ dữ liệu lịch sử để nhận diện xu hướng, dự đoán điểm yếu dễ bị khai thác và điều chỉnh mô hình quan sát khi môi trường đe dọa thay đổi. Ngoài ra, tài liệu nguồn còn nhấn mạnh các lợi ích như cải thiện trải nghiệm người dùng trong xác thực, hỗ trợ tuân thủ nhờ tự động hóa giám sát và báo cáo, và khả năng mở rộng để bảo vệ các môi trường công nghệ thông tin lớn, phức tạp.

Mặt trái của AI và các rủi ro mới

AI không chỉ đem lại lợi ích. Mỗi khi tổ chức bổ sung AI vào hạ tầng, tổ chức đó cũng đồng thời mở rộng bề mặt tấn công của mình. Trước hết là rủi ro dữ liệu. Hệ thống AI phụ thuộc rất mạnh vào dataset. Nếu dữ liệu bị sửa đổi, bị rò rỉ, bị đầu độc hoặc mang thiên lệch, kết quả của AI sẽ không còn đáng tin. Tài liệu nguồn nêu rõ rằng dữ liệu huấn luyện thiên lệch có thể dẫn đến false positive, phản hồi sai hoặc thậm chí phân biệt đối xử trong những bài toán nhạy cảm như tuyển dụng. Vấn đề ở đây không chỉ là bảo mật theo nghĩa ngăn hacker, mà còn là bảo vệ tính toàn vẹn, tính công bằng và tính hợp lệ của dữ liệu xuyên suốt vòng đời AI.

Tiếp theo là rủi ro đối với mô hình. Tác nhân xấu có thể nhắm vào mô hình để đánh cắp, đảo ngược hoặc sửa trái phép kiến trúc, trọng số và tham số. Một mô hình bị can thiệp có thể vẫn chạy bình thường nhưng cho ra quyết định sai lệch trong thời gian dài mà không bị phát hiện ngay. Điều này nguy hiểm hơn nhiều so với lỗi phần mềm thông thường, vì nó làm sai chính bộ máy ra quyết định của hệ thống.

Một nhóm rủi ro khác là tấn công đối kháng (adversarial attack) và tiêm hướng dẫn độc hại (prompt injection). Trong adversarial attack, kẻ tấn công cố ý điều chỉnh dữ liệu đầu vào sao cho hệ thống AI nhận diện sai hoặc phân loại sai. Trong prompt injection, đối tượng xấu chèn chỉ dẫn độc hại để ép công cụ AI tiết lộ dữ liệu, xóa tài liệu hoặc thực hiện hành vi ngoài mong muốn. Bên cạnh đó còn có thao túng dữ liệu đầu vào (input manipulation attack), đầu độc dữ liệu huấn luyện (data poisoning) và lợi dụng thư viện và thành phần bên thứ ba trong quá trình phát triển và triển khai (supply chain attack).

Một rủi ro âm thầm nhưng rất quan trọng là model drift và model decay. Theo thời gian, mô hình có thể suy giảm độ chính xác hoặc trở nên không còn phù hợp với bối cảnh thực tế. Khi điều đó xảy ra, những vùng yếu của mô hình có thể bị đối thủ khai thác để điều hướng đầu ra theo hướng có lợi cho họ. Vì vậy, mô hình AI không thể được xem là một sản phẩm triển khai xong rồi để nguyên. Nó phải được giám sát liên tục như một tài sản sống.

AI làm mạnh cả người phòng thủ lẫn kẻ tấn công

Một thực tế cần nhìn thẳng là AI không nghiêng về bên nào. Công nghệ này giúp bên phòng thủ mạnh hơn, nhưng cũng giúp bên tấn công mạnh hơn. FBI đã ghi nhận sự gia tăng xâm nhập mạng do tác động của AI. Một báo cáo khác cho thấy 75 phần trăm chuyên gia an ninh mạng cấp cao đang thấy số vụ tấn công tăng lên, và 85 phần trăm trong số họ cho rằng mức tăng đó có liên quan đến việc tác nhân xấu sử dụng gen AI. Điều này cho thấy AI đang làm thay đổi cán cân tấn công và phòng thủ theo cả hai chiều.

Vì vậy, câu hỏi quan trọng đối với tổ chức không còn là có nên dùng AI hay không. Câu hỏi đúng hơn là dùng AI như thế nào để nâng cấp phòng thủ mà không tạo ra một bề mặt rủi ro lớn hơn. Đây chính là lý do xuất hiện yêu cầu về secure AI, tức là phải vừa khai thác sức mạnh của AI, vừa kiểm soát được đạo đức, an toàn, bảo mật và tuân thủ trong toàn bộ vòng đời của nó.

Các ứng dụng tiêu biểu

Trong thực tế, AI security không chỉ là một công cụ riêng lẻ mà là một lớp năng lực có thể cắm vào nhiều khâu. Ở lớp bảo vệ dữ liệu (data protection), AI giúp phân loại dữ liệu nhạy cảm, theo dõi sự di chuyển của dữ liệu, phát hiện truy cập trái phép và hỗ trợ tối ưu hóa encryption cũng như tokenization cho dữ liệu khi lưu trữ và khi truyền đi.

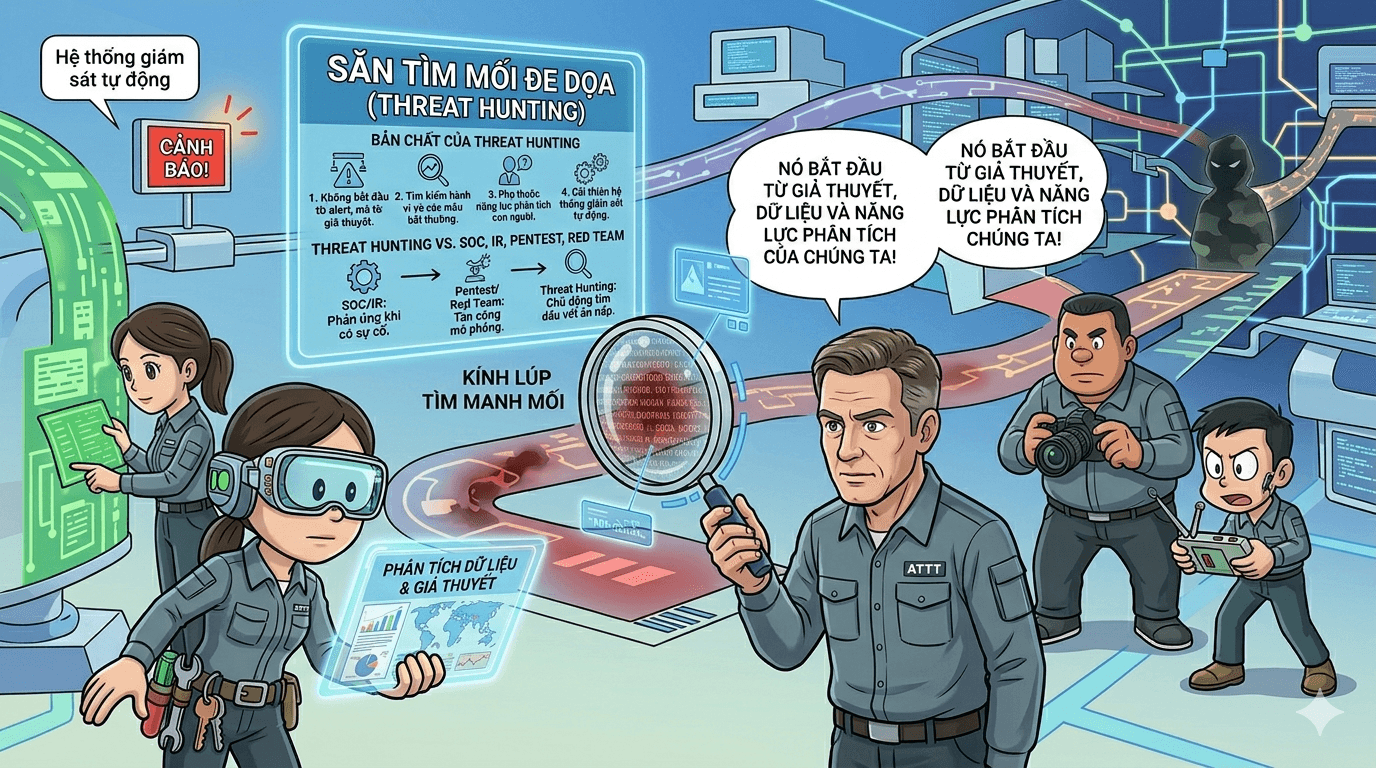

Ở lớp bảo vệ thiết bị đầu cuối (endpoint security), AI tăng cường cho EDR bằng cách theo dõi liên tục hành vi trên máy tính, máy chủ và thiết bị di động để phát hiện bất thường theo thời gian thực. Tài liệu nguồn cũng nhắc đến khả năng hỗ trợ nhận diện fileless malware và zero day attack trước khi chúng gây hại lớn. Trong hybrid cloud, AI có thể tìm shadow data, phát hiện bất thường trong truy cập dữ liệu và cảnh báo ngay khi xuất hiện dấu hiệu nguy hiểm. Với advanced threat hunting, AI giúp phân tích tập dữ liệu lớn hơn và rút ngắn thời gian tìm dấu vết xâm nhập trong mạng nội bộ.

Ngoài ra, AI còn được ứng dụng trong fraud detection, cybersecurity automation, IAM, phishing detection và vulnerability management. Nó có thể đọc dữ liệu giao dịch để phát hiện gian lận, tự động hóa quy trình phản ứng khi tích hợp với SOAR, hỗ trợ kiểm soát truy cập tinh vi hơn trong IAM, phát hiện email lừa đảo tốt hơn và ưu tiên xử lý các lỗ hổng có khả năng bị khai thác cao nhất. Nhìn tổng thể, AI đang len vào gần như toàn bộ chuỗi hoạt động của một SOC hiện đại.

Cần triển khai theo hướng nào?

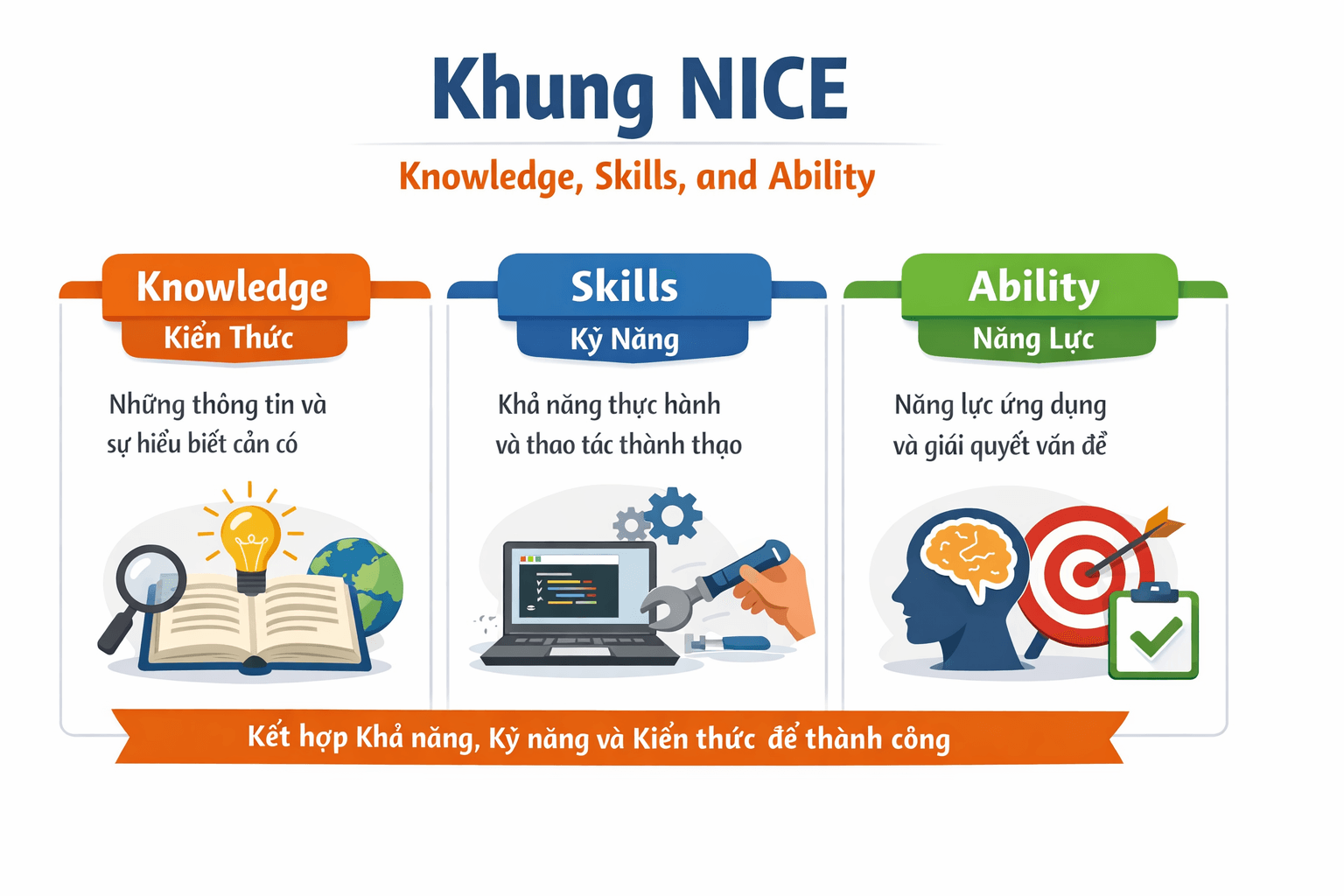

Một cách tiếp cận hợp lý không phải là chạy theo công cụ mới nhất, mà là xây dựng chiến lược AI security rõ ràng. Trước hết phải có quản trị dữ liệu (data governance) chính thức để bảo vệ dữ liệu nhạy cảm và duy trì chất lượng mô hình. Dataset phải phù hợp, chính xác và được cập nhật đều đặn để mô hình thích ứng với mối đe dọa đang thay đổi.

Tiếp theo, AI cần được tích hợp với hạ tầng bảo mật đang có như threat intelligence feed, SIEM và các nền tảng vận hành hiện hữu. Nếu triển khai rời rạc, giá trị của AI sẽ giảm mạnh và tổ chức lại phải gánh thêm độ phức tạp không cần thiết. Song song với đó là yêu cầu về minh bạch và đạo đức. Thuật toán, nguồn dữ liệu và cách dùng AI cần được tài liệu hóa rõ để giảm thiên lệch, tăng khả năng giải trình và hỗ trợ kiểm toán khi cần.

Cuối cùng, chính hệ thống AI cũng phải được áp dụng các biện pháp bảo mật giống các tài sản công nghệ khác, bao gồm encryption, access control và threat monitoring. Việc giám sát định kỳ về hiệu năng, độ chính xác và mức tuân thủ là bắt buộc, vì một mô hình hữu ích hôm nay có thể trở nên lỗi thời hoặc dễ bị khai thác sau một thời gian vận hành.

Kết luận

AI security không nên được hiểu đơn giản là bảo mật cho một công cụ AI. Đây là một khu vực chiến lược của an ninh mạng hiện đại, nơi AI vừa là công cụ phòng thủ mạnh, vừa là nguồn rủi ro mới cần kiểm soát. Giá trị lớn nhất của AI nằm ở khả năng phát hiện mối đe dọa nhanh hơn, hỗ trợ phản ứng sự cố tốt hơn, tự động hóa vận hành và mở rộng năng lực phòng thủ trong môi trường số phức tạp. Nhưng giá trị đó chỉ bền vững khi tổ chức đồng thời bảo vệ dữ liệu, mô hình, quy trình triển khai và các quyết định do AI tạo ra.

Nếu tóm gọn toàn bộ vấn đề trong một ý, có thể nói thế này: AI chỉ thực sự làm cho tổ chức an toàn hơn khi nó được triển khai như một phần của kiến trúc bảo mật có quản trị, có kiểm soát và có giám sát liên tục. Nếu thiếu những điều đó, AI rất dễ biến từ công cụ hỗ trợ thành một điểm yếu mới trong hệ thống.

bài viết được tác giả chuyển thể lại từ https://www.ibm.com/think/topics/ai-security